1人称ビデオから装着車の視線(注視点)を推測

スパースコーディングを応用して、雑音に頑健な新しい手法を提案

作業動作に関する情報などの抽出に有効

カメラデバイスが軽量、安価になることに伴い、実世界で自分の頭部などに装着したビデオカメラから得られる1人称のビデオ信号の収集と利用への期待が高まっている。

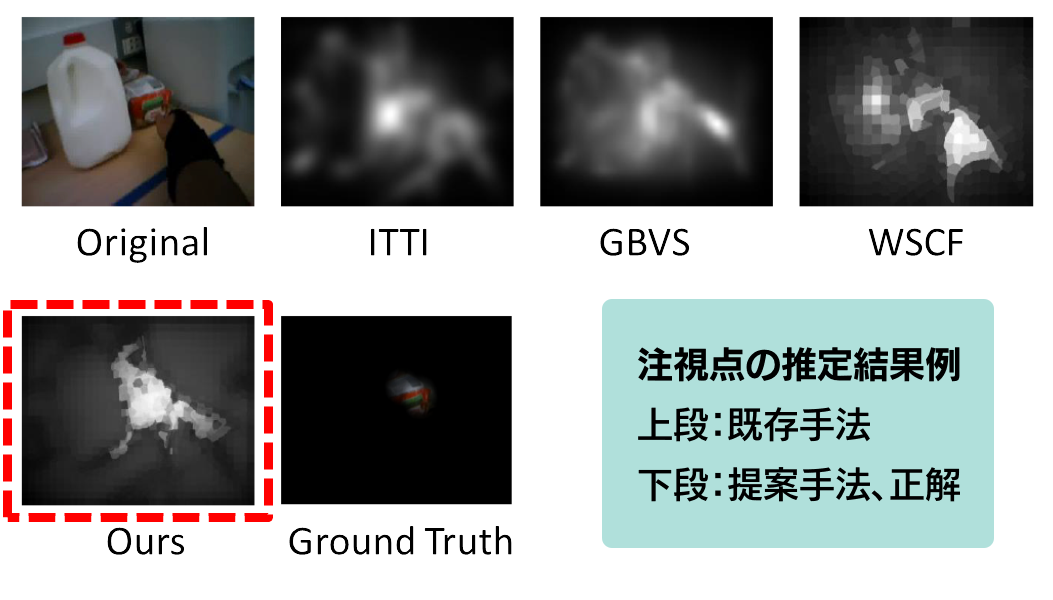

1人称ビデオの画面の中の注視点を推定することで、作業において重要な対象や動作などの情報を抽出することが可能になるが、これまでの注視点予測主張は、視覚的な興味深さ(saliency)に基づくものであり、1人称ビデオに多く含まれる雑音に対して頑健ではない。

そこで、スパースコーディングを応用して、雑音に頑健な新しい視線予測を開発し、モジュール化した。

MATLAB のソースコードを公開

https://github.com/aistairc/SC_based_gaze_prediction

手法の詳細の論文

Yujie Li, Atsunori Kanemura, Hideki Asoh, Taiki Miyanishi, and

Motoaki Kawanabe, "A sparse

coding framework for gaze prediction in egocentric video", IEEE International Conference on Acoustics,

Speech, and Signal Processing (ICASSP), pp. 1313–1317, 2018 DOI: 10.1109/ICASSP.2018.8462640

| 研究開発プロジェクト | NEDO 次世代人工知能・ロボット中核技術開発の成果 |

| 研究機関 | 国立研究開発法人 産業技術総合研究所 |

| 主要研究者 | Yujie Li(産業技術総合研究所、現 桂林電子科技大) |